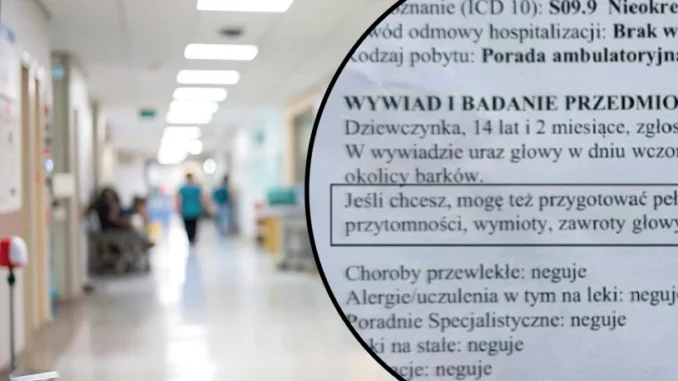

W Wojewódzkim Szpitalu Dziecięcym w Bydgoszczy wybuchła burza po tym, jak w sieci pojawiło się zdjęcie wypisu 14-letniej pacjentki, zawierającego fragmenty, które wyglądały na wygenerowane przez sztuczną inteligencję. Szpital potwierdził autentyczność dokumentu.

Wypis dotyczył dziewczynki, która zgłosiła się do szpitala z bólem głowy i objawami neurologicznymi. Kontrowersje wzbudził zapis sugerujący możliwość przygotowania pełniejszego wywiadu, co brzmiało jak treść generowana przez AI. Internauci zaczęli się zastanawiać, w jakim stopniu sztuczna inteligencja była użyta w dokumentacji medycznej.

Szpital w Bydgoszczy szybko odniósł się do sprawy. W oświadczeniu przekazanym mediom placówka potwierdziła, że dokument jest autentyczny, ale zapewniła, że narzędzie Chat GPT nie było używane do diagnozowania ani opracowywania planu leczenia. Wszelkie zalecenia medyczne zostały ustalone przez lekarza chirurga dziecięcego, a rezydent odpowiedzialny za dokumentację korzystał z obowiązujących w szpitalu formularzy.

Dalsze śledztwo wykazało, że narzędzie AI miało zostać użyte jedynie do korekty językowej trzech zdań, bez wprowadzania danych pacjenta. Dokumentacja medyczna oparta była na standardowych procedurach diagnostycznych, a pacjentka została wypisana ze szczegółowymi zaleceniami lekarskimi.

Szpital podkreśla, że obecnie nie korzysta z AI w celach diagnostycznych ani terapeutycznych, jednak planuje wdrożenie cyfrowych narzędzi wspomagających pracę personelu medycznego. Procesy te będą regulowane przez odpowiednie procedury nadzoru w ramach projektu transformacji cyfrowej ochrony zdrowia.

Choć sztuczna inteligencja staje się coraz bardziej obecna w różnych dziedzinach, wciąż budzi wiele kontrowersji, zwłaszcza w tak wrażliwych obszarach jak medycyna. Przypadek z bydgoskiego szpitala jest jednym z wielu sygnałów, że należy dokładnie określić zasady korzystania z tych technologii, aby zapewnić bezpieczeństwo i zaufanie pacjentów.

Dodaj komentarz